Da qualche tempo meditavo di introdurre ai miei contatti “sistemistici” il mondo “industrial PC”, che di fatto “frequento” almeno dal 2009, e che ho avuto modo di introdurre “concretamente” in Edison … l’occasione mi è stata fornita da Contradata, che ha deciso di mettermi a disposizione un PC industriale di dimensioni veramente ridotte di IEI, oltre a un disco SSD decisamente peculiare di InnoDisk, prodotti che ho poi avuto modo di gestire attraverso un prodotto altrettanto interessante di InnoDisk, vale a dire il piccolissimo “InnoAgent”‘

1. ITG-100-AL

In questo caso siamo davanti ad un comunissimo PC, ma completamente senza ventole, e di dimensioni ridottissime: 137 x 102.8 x 56.2 mm.

E’ costruito intorno ad un soc Intel atom x5-E3930: stiamo quindi parlando di un prodotto lanciato a fine 2016, che supporta un massimo di 8GB di ram LPDDR3 … con questo articolo vorrei dare evidenza di quanto possa aver senso nel 2022 considerare una macchina con tali specifiche, paragonandola al comune notebook che uso per scrivere questo articolo.

Nella sua configurazione “di fornitura”, è equipaggiato con 2GB di ram LPDDR3 non ECC (anche se la memoria ECC è supportata) e un disco mSATA su bus PCIe da 64GB: essendo un prodotto concepito per uso “industrial”, quindi con sistemi operativi compatti tipo Windows “IoT” piuttosto che distribuzioni Linux con footprint “ridotto”, si tratta di una dotazione più che sufficiente.

Siccome il mio obiettivo però è di dare un idea a chi non ha “consuetudine” con il mondo industrial, ho effettuato test con sistemi operativi del tutto standard, anche per farmi un idea di cosa si può fare con un simile PC in un comunissimo utilizzo “daily office”.

Sono quindi partito effettuando un benchmark con il PC con cui scrivo l’articolo, un contemporaneo Samsung Book2 PRO con 16GB di ram, utilizzando la nota suite “Passmark Performance Test” nella sua versione 10.2 , ottenendo uno score complessivo di 3789 punti … vediamo come si comporta a confronto il MiniPC nella sua configurazione base.

1.1 Test Win10 Pro x86 + 2GB Ram

2GB di ram sarebbero sufficienti anche per una versione “base” di Windows 10 x64, ma per un uso “ragionevole” e per poter fare un test di utilizzo con software “comune” ho deciso di fare un primo test con la versione a 32bit nella configurazione base.

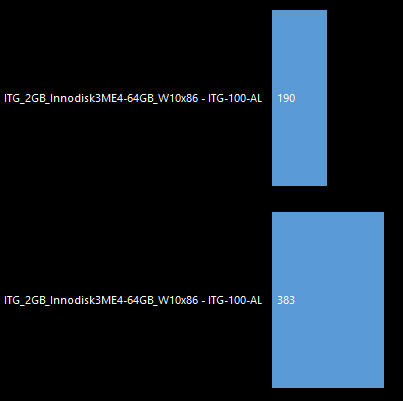

Il paragone con il mio notebook di ultima generazione “sembra” impietoso per quanto riguarda l’indice “globale” di prestazioni, cosa tuttosommato ragionevole se non altro per una macchina che costa 8 volte tanto.

Da notare comunque la differenza di prestazioni fra un’installazione “standard” di Windows 10 e dopo l’installazione di tutti i driver, operazione che da sola riesce a raddoppiare le prestazioni.

In questa configurazione comunque la macchina finisce per fare il boot in 20 secondi dalla pressione del pulsante di accensione, di cui i primi 10 per la diagnostica … un risultato del tutto dignitoso.

1.1b Test Win10 Pro x86 + 4/8GB Ram

La macchina è dotata di un unico slot LPDDR3, che permette di sostituire il banco da 2GB originale con uno da 4 o da 8, operazione che ho fatto ottenendo un punteggio di benchmark sostanzialmente identico in tutti i casi: ovvio che con 8GB di ram è possibile tranquilamente disabilitare la memora virtuale e utilizzare più applicativi in un utilizzo comune, mentre la configurazione a 2GB si presta più per applicativi verticali di tipo industriale.

1.1.c Test Knoppix 9.1 + 2GB Ram

2GB di ram sono comunque abbondantemente sufficienti per una distribuzione di Linux “live” come Knoppix: ho quindi utilizzato per un paio d’ore la macchina con la recente versione 9.1 che è risultata di una fluidità eccellente, sia nella comune navigazione con Chromium che nell’utilizzo di documenti Word e fogli di calcolo con OpenOffice, senza poter avere contezza che si trattasse di qualcosa di diverso dal mio notebook tradizionale.

Per confronto, anche in questo caso avrei voluto utilizzare la suite Passmark, pur disponibile per Linux, ma in nessun modo sono riuscito a farla girare su questa distribuzione, anche installandola sul disco SSD locale, rimandando il test all’utilizzo con Ubuntu.

1.2 Test Win10 Pro x64 2/4/8GB Ram

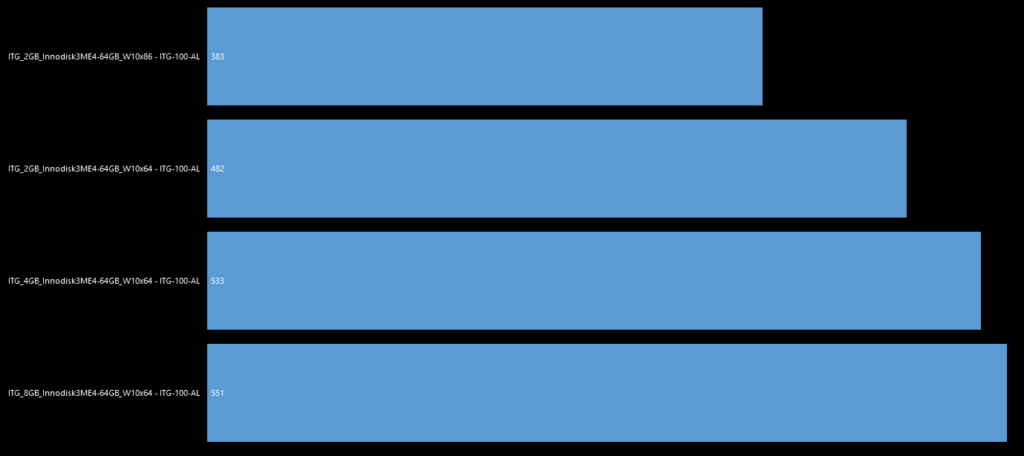

Installando invece una copia di Win10 a 64bit, resta evidente l’impatto della memoria ram aggiuntiva: se l’indice complessivo con Win10 a 32bit è pari a 383, con la versione a 32bit sale a 482, che passano a 533 con 4GB di ram e 551 con 8GB di ram.

1.3 Test Win11 Pro x64+ 8GB Ram

4GB di ram sono sufficienti anche per un installazione con Windows 11, anche se questo miniPC manca di un chip TPM

1.4 Test Win11 Pro x64+ 8GB Ram

8GB di ram diventano più che sufficienti per l’esecuzione di Windows 11 64 bit disabilitando la memoria virtuale, operazione praticamente indispensabile su una macchina industriale per consentirne la durabilità, specie in termini di usura dei supporti di memoria a stato solido.

1.4.1 Test con Office365

1.4.1 Test con Autocad 2D

Innodisk 3ME4 / 870EVO / InnoOSR /

1.5 Conclusioni

Comparazione commentata di tutti i benchmark

- Test con Disco M.2 A-Key aggiuntivo interno

- Test con Disco SSD Sata aggiuntivo

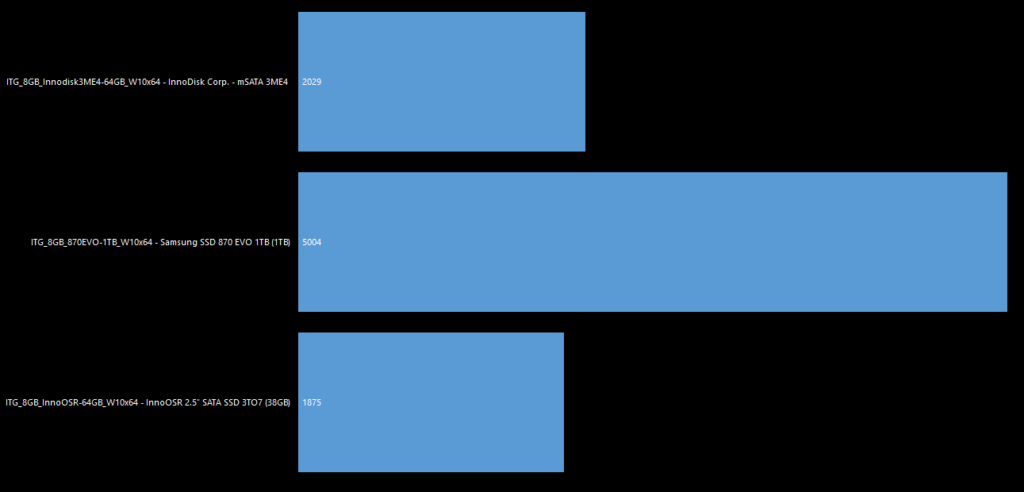

- Test con InnoOSR 64GB

Comparazione commentata di tutti i benchmark

- Utilizzo di un mese come Office PC

- Utilizzo di un mese come Car PC

2. InnoOSR 2.5” SATA SSD 3TO7

Veniamo ora al disco SSD, del quale Innodisk dichiara essere il primo prodotto al mondo con funzionalità di “System Recovery” implementate a livello di firmware, il tutto allo scopo di “tagliare alla radice” ogni problema di compatibilità software.

Esteticamente il prodotto si presenta come un comune SSD, con in più un piccolo header da 4 pin, di cui due dedicati a un led, ed un altro di tipo GPIO; quest’ultimo, in estrema sintesi, può essere cortocircuitato da un qualsiasi pulsante per “iniziare” le procedure di ripristino, oppure pilotato da un’altro device GPIO che faccia la stessa cosa via software, con intervento umano o proceduralmente.

Per connetterlo al pc IEI ho utilizzato l’a’unica porta SATA in dotazione, alimentando il disco con un’alimentatore ATX esterno, non avendo a disposizione per il mio test lo specifico box di espansione IEI ITG-100-AL-E1 ma il risultato è perfettamente equivalente.

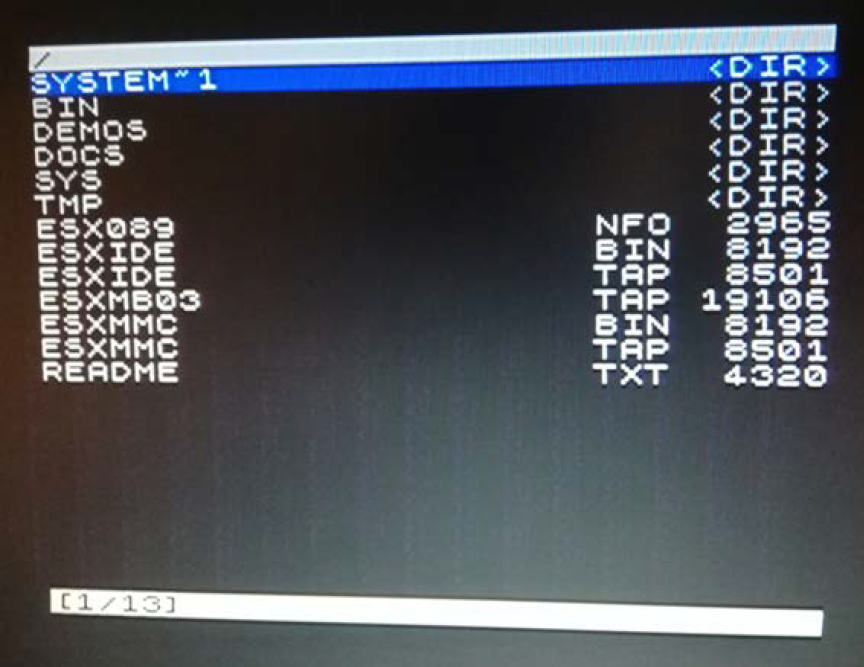

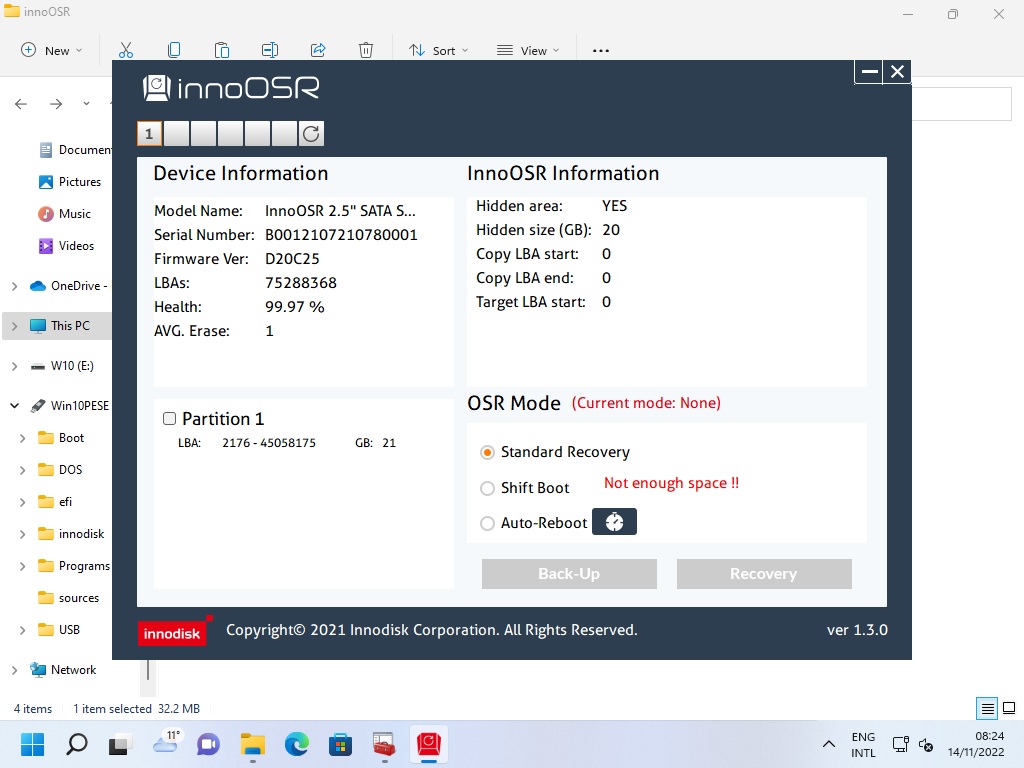

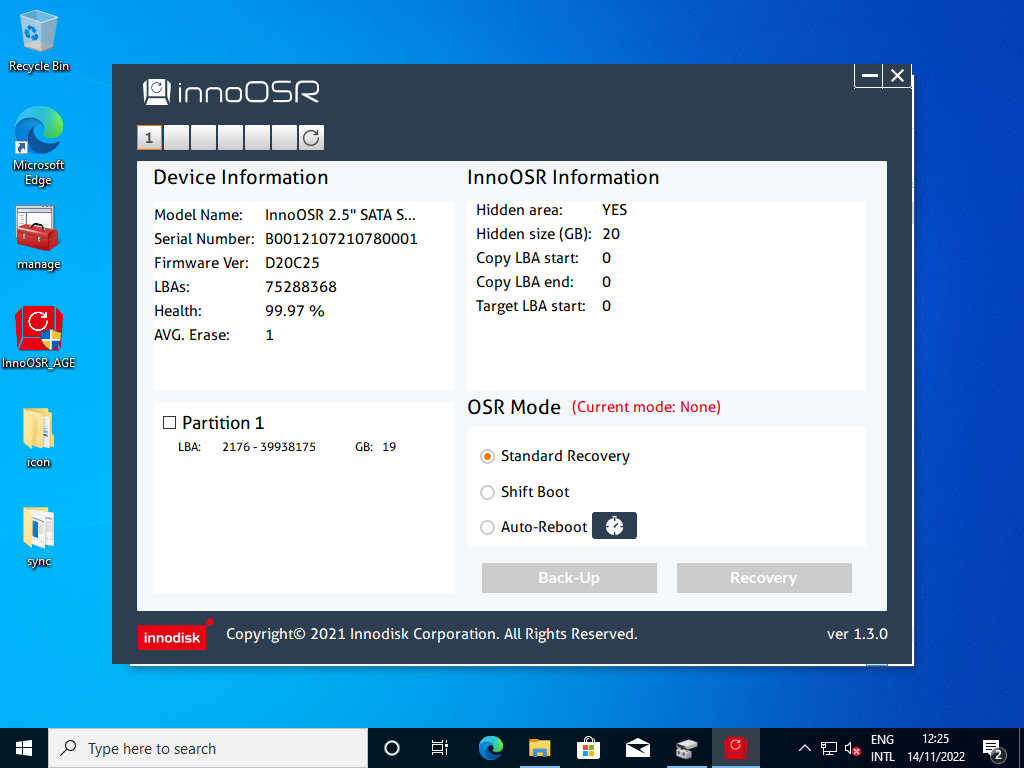

Alla prima connessione il disco si presenta a Windows come un SSD da 35.90 GB non partizionato, da poter quindi usare come un disco comune; lanciando invece il tool “InnoOSR_AGE”, una gradevole interfaccia grafica ci informa che il disco ha a disposizione un’area “nascosta” da 20GB, il che rende conto della riduzione di dimensione che appare al sistema operativo.

2.2 Test della funzionalità di ripristino via software

Siccome avevo scelto di fare un’installazione di Windows 10 su una partizione da 21GB, al primo utilizzo sono stato informato da InnoOSR che la partizione nascosta non aveva spazio a sufficienza per poter ricevere un BackUp tale da permettere la funzione di “Standard Recovery”, quindi ho ridotto ulteriormente la dimensione della partizione di sistema allo scopo di poter effettuare il primo Backup.

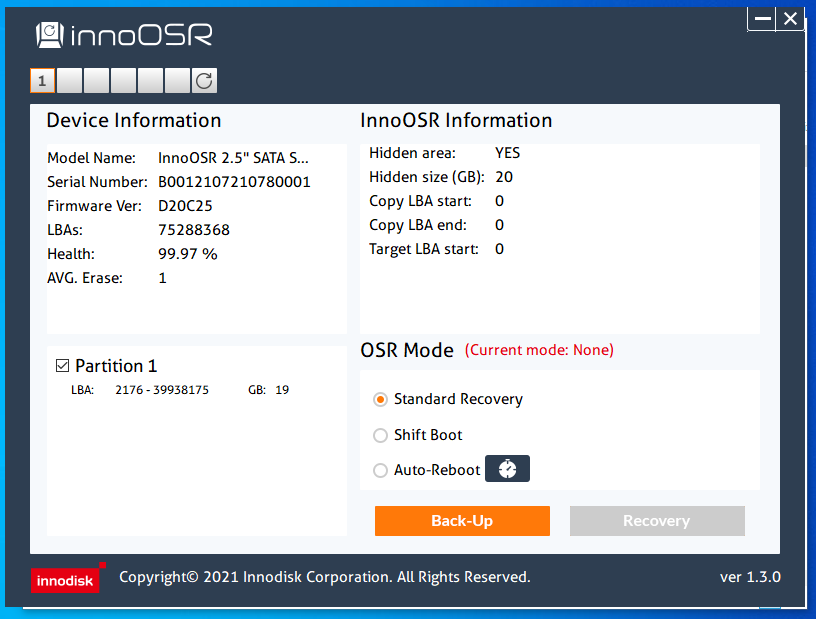

Ridimensionata la partizione di sistema, bisogna selezionarla specificamente: ciò fa intendere come il backup sia inteso non dell’intero disco, ma di una singola partizione: è ovvio che in questi casi, per una resilienza maggiore in termini di disaster recovery, sia opportuno installare windows in un’unica partizione piuttosto che premettergli quella standard per i file di boot e per il recovery. Selezionata la prima partizione a questo punto è possibile procedere ad un primo backup:

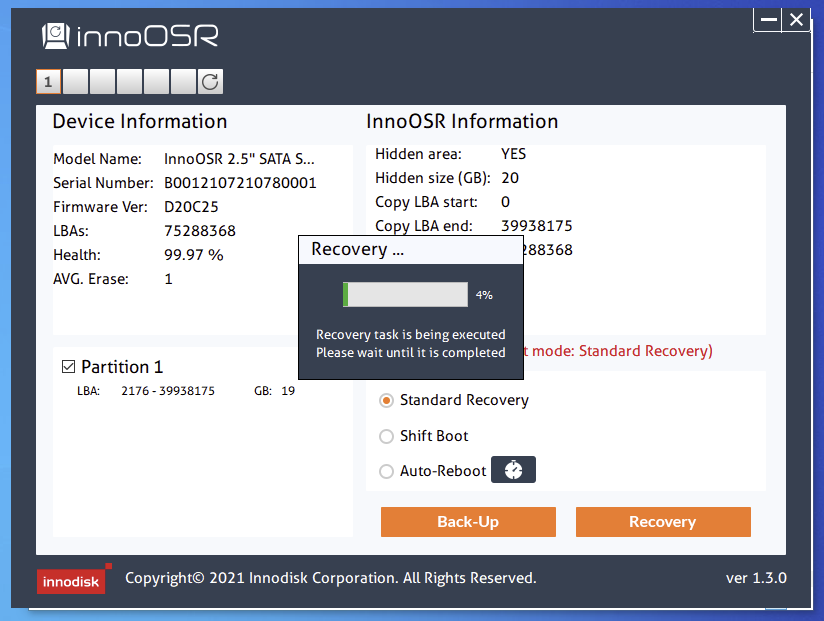

La pressione del tasto “backup” genera la comparsa per un breve istante di una finestra di command line, dopodichè parte la procedura di backup, che in questo caso è durata circa sei minuti; al termine il software ha effettuato uno shutdown della macchina.

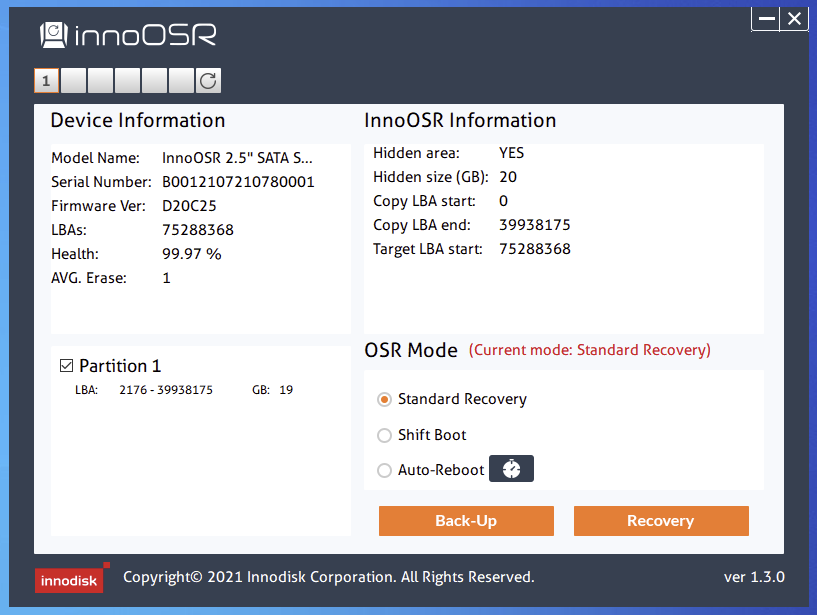

Dopo il reboot il tool innoOSR offriva in effetti la possibilità di fare il recovery:

come primo test ho effettuato delle modifiche al sistema ed effettuato il primo recovery, anche in questo caso durato circa sei minuti.

Anche al termine della procedura il software ha causato uno shutdown, dopo il quale il sistema era in effetti tornato nelle condizioni precedenti alle mie modifiche.

A questo punto è intervenuto un “problema”, probabilmente di gioventù dello specifico firmware: la partizione di sistema così “ripristinata” si è rivelata non modificabile …

2.2 Test della funzionalità di ripristino mediante interrupt GPIO

Il cavetto con led e pulsante fornito in dotazione in linea di principio permetterebbe di effettuare il recovery con un input “hardware” umano tenendolo premuto per più di cinque secondi … in realtà la cosa non ha funzionato, immagino sempre per problemi di gioventù del firmware

Supports Hardware GPIO and Software Triggering

Reserved GPIO Pins to Accommodate your System Design

2.3 Conclusioni

In conclusione: un disco InnoOSR da 64GB si presenta al sistema come un disco SATA da 35.90GB … la parte “riservata” del disco NON è visibile da sistema operativo e la sua dimensione NON si può modificare senza l’intervento di innodisk

3. InnoAgent EZ2N-0XL1

Come ultima parte della prova di “materiale industriale”, ho utilizzato un piccolissimo modulo, sempre dello stesso produttore del disco SSD, che è concepito espressamente per il management “out of band” di soluzioni industriali. Si tratta di una piccola daughterboard